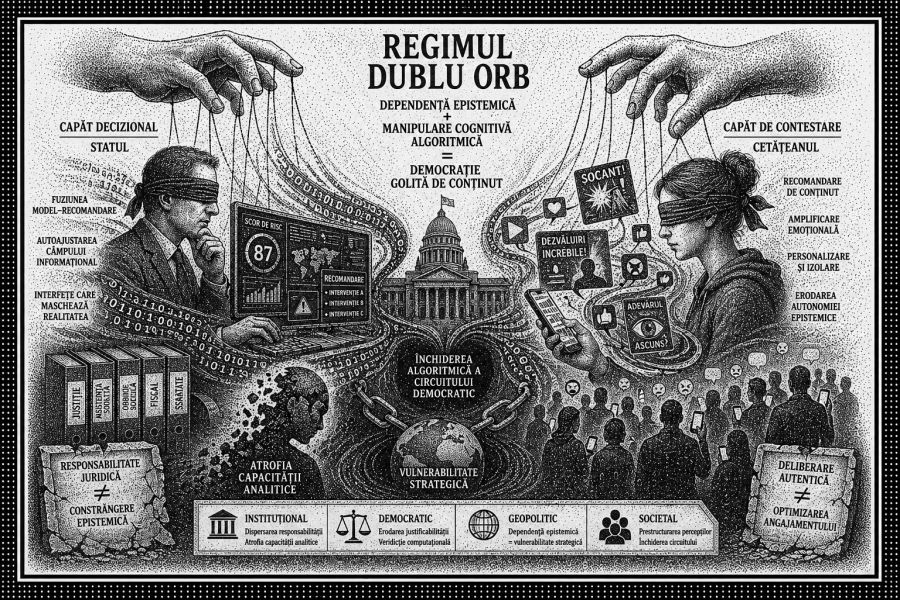

Cum dependența epistemică și manipularea cognitivă algoritmică golesc democrația de conținut

1. Introducere

Teza centrală a acestui articol este că integrarea sistemelor algoritmice predictive în infrastructura decizională a statului erodează o precondiție fundamentală a guvernării democratice: existența unei imagini contestabile a lumii, separabilă de decizia de acțiune și disponibilă pentru evaluare independentă. Această erodare nu este rezultatul unei disfuncții tehnice sau al unei decizii politice explicite. Ea este o consecință structurală a modului în care aceste sisteme funcționează în regim normal și a modului în care statele le integrează fără instrumentele conceptuale adecvate.

Dar teza are și o a doua dimensiune, care o completează și îi amplifică gravitatea. Dacă la dependența epistemică a statului se adaugă capacitatea infrastructurilor algoritmice de a modela percepțiile, preferințele și reacțiile cetățenilor, atunci riscul nu mai privește doar opacizarea procesului decizional intern al statului, ci închiderea întregului circuit democratic. Democrația nu este anulată în sens formal, pentru că instituțiile și procedurile continuă să existe. Dar ea riscă să fie golită de conținut prin închiderea algoritmică a ambelor capete ale circuitului democratic: atât producerea deciziei, cât și producerea contestării ei.

Diferența pe care o propunem este fundamentală: nu este vorba despre a nu ști ce se întâmplă, ci despre a acționa într-un regim în care întrebarea despre ce se întâmplă a încetat să mai fie operațională ca bază distinctă pentru guvernare. Statele contemporane care integrează sisteme de analiză predictivă în procesele lor decizionale nu traversează prima situație, ci pe a doua. Problema nu este de acces la informație sau de transparență insuficientă. Este o mutație în logica prin care guvernarea devine posibilă, o mutație care afectează direct condițiile în care cetățenii, parlamentarii sau judecătorii pot exercita controlul democratic.

Pentru a înțelege profunzimea acestei mutații, este util să apelăm la o perspectivă filosofică asupra modului în care tehnologia structurează percepția. Martin Heidegger observa că modernitatea s-a definit prin transformarea lumii într-o imagine, un tablou pe care omul îl poate privi, măsura, clasifica și controla din exterior. În epoca algoritmilor predictivi, depășim chiar și acest stadiu. Lumea încetează să mai fie o imagine coerentă oferită contemplării umane și devine un flux continuu de date procesabile, un stoc de informații disponibil pentru o optimizare perpetuă. Reprezentarea conceptuală este înlocuită de calculul statistic în timp real. În același registru, Vilém Flusser a introdus conceptul de imagini tehnice, explicând că noile medii nu mai reprezintă lumea fizică în sensul clasic, ci o proiectează pe baza unui calcul matematic. Imaginea tehnică este un construct generativ care nu se referă la o realitate externă stabilă, ci creează o nouă realitate funcțională. Funcționarul public contemporan care privește un ecran plin de scoruri de risc nu privește o reprezentare directă a cetățeanului din fața sa, ci o proiecție statistică generată de algoritm. Iar cetățeanul care navighează într-un mediu informațional algoritmizat nu accesează o reprezentare neutră a realității politice, ci o proiecție optimizată pentru captarea și direcționarea atenției sale.

Formularea care dă titlul acestei analize necesită însă o precizare conceptuală clară. Nu este vorba despre dispariția oricărei forme de cunoaștere din procesul decizional guvernamental. Sistemele algoritmice predictive produc o formă de inteligență aplicată care este adesea superioară analizei umane clasice în ceea ce privește viteza de reacție, volumul de date procesate simultan și capacitatea de a identifica corelații invizibile cu ochiul liber. Ceea ce se pierde nu este informația brută, ci un tip specific de raportare la realitate: imaginea lumii ca reprezentare contestabilă, separabilă de acțiune, pe care decidentul o poate evalua, respinge sau corecta critic înainte de a decide. În sistemele algoritmice integrate profund în birocrația de stat, această imagine nu dispare, ci devine implicită. Ea este încorporată în structura rezultatelor sistemului, devine inseparabilă de recomandarea de acțiune și, prin urmare, indisponibilă pentru o evaluare independentă în sensul pe care democrația liberală îl presupune.

Literatura existentă a tematizat relația dintre algoritmizare și guvernare din trei perspective principale. Prima se concentrează pe opacitatea algoritmică drept amenințare la adresa responsabilității democratice. A doua analizează implicațiile pentru procedura legală și pentru drepturile individuale. A treia, mai recentă, abordează problema suveranității digitale la nivel statal. Contribuția acestui articol constă în articularea unui al patrulea unghi: consecințele epistemice și strategice ale dependenței instituționale față de sistemele algoritmice, privite nu din perspectiva individului afectat de o decizie automatizată, ci din perspectiva statului ca actor care guvernează, a cetățeanului ca agent al controlului democratic și a democrației ca sistem a cărui funcționare depinde de integritatea epistemică a ambelor capete ale circuitului.

Patru concepte vor fi utilizate consecvent de-a lungul articolului, iar precisarea lor este esențială pentru coerența argumentului. Prin „imagine a lumii” înțelegem o reprezentare contestabilă a realității, separabilă de recomandarea de acțiune, pe care un decident o poate evalua critic înainte de a decide. Prin „dependență epistemică” înțelegem pierderea capacității unei instituții sau a unui actor de a configura independent câmpul în care informația devine semnificativă și decizia devine formulabilă. Prin „câmp decizional” înțelegem totalitatea opțiunilor vizibile pentru decident, inclusiv criteriile prin care unele opțiuni devin vizibile și altele nu. Prin „veridicție computațională” înțelegem procesul prin care deciziile și judecățile sociale complexe sunt traduse în clasificări probabilistice generate de mașini și prezentate apoi ca adevăruri obiective, tehnice și neutre.

Articolul procedează astfel: secțiunea a doua stabilește precondițiile epistemice ale legitimității democratice, identificând separabilitatea dintre reprezentare și decizie drept condiție structurală a controlului democratic și examinând rolul fricțiunii instituționale și al nedreptății epistemice; secțiunea a treia demonstrează cum funcționarea normală a sistemelor algoritmice predictive erodează tocmai această separabilitate; secțiunea a patra analizează consecințele acestei erodări pe patru paliere, instituțional, democratic, geopolitic și societal, arătând cum dependența epistemică se cumulează și cum închiderea algoritmică a ambelor capete ale circuitului democratic transformă riscul epistemic în risc sistemic; secțiunea a cincea derivă din analiza anterioară un cadru de evaluare și patru principii de răspuns instituțional; secțiunea a șasea concluzionează prin sintetizarea argumentului, identificarea limitelor analizei și formularea întrebărilor care rămân deschise.

2. Precondițiile epistemice ale legitimității democratice

Guvernarea în regim democratic nu se legitimează doar prin decizia luată, ci și prin reprezentarea realității pe baza căreia decizia a fost luată. Într-o societate liberă, cunoașterea și puterea sunt inseparabile în actul de guvernare, iar modul în care statul alege să cunoască realitatea dictează limitele puterii sale. Această teză, implicită în teoria discursivă a democrației, are o consecință structurală rareori formulată explicit: separabilitatea dintre reprezentarea situației și decizia de acțiune.

Dar această separabilitate nu se exercită într-un vid. Ea presupune că ambele capete ale circuitului democratic funcționează cu un grad suficient de autonomie epistemică. La un capăt, statul trebuie să fie capabil să producă și să examineze critic propriile reprezentări ale realității. La celălalt capăt, cetățenii trebuie să fie capabili să formeze judecăți politice relativ autonome, pe baza unor informații accesibile și a unei deliberări autentice. Controlul democratic funcționează doar dacă ambele condiții sunt îndeplinite simultan.

Pentru a înțelege de ce separabilitatea este esențială la capătul decizional, trebuie să examinăm cum funcționează controlul democratic în practică. Un cetățean, un parlamentar sau un judecător care contestă o decizie guvernamentală poate face acest lucru pe două căi distincte. Pe de o parte, poate contesta decizia însăși, argumentând că, și în condițiile în care situația a fost corect înțeleasă, răspunsul ales nu a fost adecvat. Pe de altă parte, poate contesta imaginea lumii pe baza căreia s-a decis, argumentând că situația a fost înțeleasă greșit sau incomplet. Aceste două forme de contestare sunt complementare, iar eficacitatea controlului democratic depinde de posibilitatea exercitării lor independente. Dacă reprezentarea și decizia sunt fuzionate într-un singur act care nu poate fi descompus, nici una dintre cele două întrebări nu mai poate fi formulată cu precizie, iar controlul democratic pierde punctul de aplicare.

Această cerință a justificabilității publice nu reprezintă un simplu ideal normativ desprins de realitatea administrativă. Ea constituie condiția operațională de bază fără de care mecanismele de control democratic, incluzând supravegherea parlamentară, controlul jurisdicțional exercitat de instanțe și dezbaterea din societatea civilă, se transformă în structuri de fațadă. Dacă un factor de decizie guvernamental nu poate articula clar pe baza cărei înțelegeri a situației a acționat, controlul exercitat asupra acelei decizii devine un exercițiu ceremonial.

Funcționarea sănătoasă a democrațiilor se bazează, în plus, pe un principiu care este rareori articulat explicit, dar care operează constant: fricțiunea instituțională. Puterea centrală întâmpină o rezistență procedurală, birocratică și morală în interiorul propriilor instituții, deoarece aceste instituții sunt populate de ființe umane cu o capacitate critică proprie. Funcționarii publici dezbat meritele unei directive, evaluează nuanțele unor cazuri excepționale, invocă circumstanțe atenuante, adaptează regulile stricte la realitățile complexe din comunitate și, uneori, încetinesc în mod deliberat deciziile pe care le consideră disproporționate sau rupte de realitate. Această fricțiune nu este o sursă de ineficiență care trebuie eliminată, ci un mecanism de protecție. Funcționarul care ezită, care cere documente suplimentare sau care interpretează o lege în spiritul ei și nu doar în litera ei protejează cetățeanul de rigiditatea absolută a puterii de stat aplicate mecanic. Sistemele algoritmice avansate sunt propuse tocmai cu promisiunea eliminării acestei fricțiuni, în numele eficienței și al neutralității matematice. Însă o eficiență perfectă, lipsită de orice formă de dezbatere și opoziție internă, este incompatibilă cu funcționarea unei societăți libere.

Pierderea acestei capacități umane de mediere generează un fenomen pe care teoria filosofică recentă îl numește nedreptate epistemică. Nedreptatea epistemică apare atunci când o persoană suferă un prejudiciu în calitatea sa fundamentală de subiect rațional, capabil să cunoască realitatea și să transmită cunoaștere validă. În contextul guvernării bazate pe sisteme predictive, forma cea mai gravă a acestui fenomen este nedreptatea hermeneutică, care se produce atunci când o comunitate sau un grup social vulnerabil este lipsit de resursele conceptuale necesare pentru a înțelege, articula și denunța propria experiență de marginalizare. Profilarea algoritmică la scară largă fragmentează experiența civică: în loc să fie tratați ca membri ai unei comunități cu drepturi egale, cetățenii interacționează cu statul ca indivizi izolați. Fiecare persoană primește un scor de risc unic, generat într-un mediu digital personalizat, fără a ști câți alți oameni se află în aceeași situație. Această izolare distruge baza solidarității cetățenești și împiedică formarea unei înțelegeri colective a modului în care o instituție poate discrimina sistematic. Dacă un sistem informatic clasifică incorect mii de cetățeni ca prezentând un risc ridicat de fraudă socială, acești oameni nu știu unii de existența celorlalți, nu cunosc datele care i-au incriminat și nu dispun de acces la modelul matematic pentru a-i demonstra erorile. Statul creează astfel o lacună hermeneutică în locul în care ar fi trebuit să existe o argumentație democratică transparentă.

Această dinamică instaurează ceea ce putem numi veridicție computațională: un proces prin care deciziile administrative sunt extrase din sfera dezbaterii politice și a judecății umane și sunt transformate în probleme de optimizare matematică. Odată ce un sistem algoritmic calculează o probabilitate, rezultatul capătă o aură de obiectivitate științifică, fiind dificil de contestat de către un funcționar obișnuit sau de către un cetățean fără pregătire în știința datelor. Statul deleagă funcția sa de a discerne adevărul către un sistem care evaluează plauzibilitatea statistică, nu adevărul faptic.

O precizare importantă se impune aici, pentru că argumentul în favoarea separabilității nu trebuie confundat cu o idealizare a proceselor decizionale tradiționale. Democrațiile nu au funcționat niciodată cu reprezentări perfecte ale realității. Judecata umană este supusă unor distorsiuni sistematice documentate extensiv în literatura despre raționamentul în condiții de incertitudine. Cazul evaluărilor de informații privind armele de distrugere în masă din Irak, în 2003, rămâne un exemplu paradigmatic al modului în care o imagine a lumii construită prin procese complet umane a putut fi sistematic eronată, fără mecanisme eficiente de corecție. Prin urmare, orice argument în favoarea menținerii capacității analitice umane trebuie să fie cinstit cu privire la limitele acesteia și nu poate postula o alternativă idealizată față de sistemele algoritmice.

Diferența crucială este că, în trecut, chiar și cele mai distorsionate politici publice puteau fi, cel puțin în principiu, identificate ca atare, criticate și corectate. Distorsiunea era vizibilă și vulnerabilă la critică tocmai pentru că exista o doctrină, un regulament sau o expunere de motive pe care oponenții o puteau ataca punctual. Ceea ce este cu adevărat nou în situația actuală nu este imperfecțiunea imaginii, ci erodarea treptată a condițiilor în care imaginea poate fi separată de acțiune și supusă contestării independente. Problema nu este că algoritmul greșește din când în când, ci că structura însăși a erorii sale este incognoscibilă pentru societate.

Problema devine astfel una de arhitectură instituțională cu implicații directe pentru teoria democratică: ce se întâmplă cu legitimitatea guvernării atunci când precondițiile ei epistemice încetează să mai fie îndeplinite structural, nu doar la capătul decizional, ci și la capătul contestării? Secțiunile următoare demonstrează cum funcționarea normală a sistemelor algoritmice predictive produce tocmai acest efect și cum cele două erodări se întâlnesc într-o buclă care riscă să scoată cetățeanul din circuitul efectiv al democrației.

3. Mecanismul prin care guvernarea pierde imaginea contestabilă a lumii

Dacă separabilitatea dintre reprezentare și decizie este precondiția epistemică esențială a controlului democratic, iar fricțiunea instituțională este mecanismul care o protejează în practică, așa cum am argumentat în secțiunea anterioară, atunci trebuie să examinăm cu precizie modul în care sistemele algoritmice predictive afectează tocmai aceste condiții. Argumentul acestei secțiuni este că erodarea nu se produce printr-un singur mecanism, ci prin convergența a trei caracteristici ale acestor sisteme: fuziunea dintre model și recomandare, autoajustarea continuă a câmpului informațional și efectul interfețelor asupra percepției operatorului. Fiecare dintre aceste caracteristici afectează separabilitatea într-un mod specific, iar împreună ele produc o situație în care imaginea contestabilă a lumii devine structural inaccesibilă.

Într-un sistem clasic de analiză guvernamentală, lanțul decizional este segmentat: date brute, interpretare, reprezentare, decizie. Fiecare verigă poate fi, în principiu, contestată separat. Un analist poate obiecta că setul de date inițial este incomplet. Un alt expert poate argumenta pe baze metodologice că modul în care au fost interpretate cifrele este viciat de prejudecăți. Factorul de decizie politic poate concluziona că, deși analiza tehnică este corectă, intervenția propusă nu se justifică din cauza unor costuri colaterale inacceptabile. Sistemul clasic produce o imagine a lumii asumată de un grup de oameni, iar acea imagine poate fi pusă oricând în discuție, respinsă, corectată sau completată pe măsură ce apar noi informații.

Este important să nu idealizăm acest model. Sistemele clasice au implicat întotdeauna filtrare, prejudecăți instituționale și cadre conceptuale care prestructurau vizibilitatea. Un serviciu de analiză care selectează doar o anumită fracțiune din rapoartele de pe teren pentru a ajunge pe biroul ministrului exercită o putere de filtrare considerabilă. O procedură administrativă care impune categorii standardizate de raportare exclude din oficiu orice aspect al realității care nu se încadrează în formularele aprobate. Diferența dintre sistemele clasice și cele algoritmice predictive nu este una între transparență și opacitate în sens absolut. Este o diferență privind natura, auditabilitatea și contestabilitatea instituțională a procesului de filtrare. Într-un sistem clasic, filtrarea este produsul unor judecăți umane care pot fi identificate, articulate și, în principiu, contestate. Un funcționar poate fi chemat la audieri și întrebat de ce a considerat anumite riscuri ca fiind prioritare, ignorând alți factori. O procedură discriminatorie poate fi invalidată de o instanță. Chiar și atunci când aceste contestări nu au loc în practică, ele rămân posibile ca structură. Tocmai această posibilitate structurală este cea care se erodează în cazul sistemelor algoritmice predictive.

Prima caracteristică prin care se produce erodarea este fuziunea dintre model și recomandare. Sistemele algoritmice predictive funcționează diferit de cele clasice nu doar ca grad de complexitate, ci ca logică internă. Ele primesc fluxuri continue de date, le procesează prin modele statistice complexe și produc în timp real o ierarhizare a intervențiilor posibile, fiecare cu o probabilitate de succes atașată. Modelul nu este extern și explicit, ci intern și emergent, generat prin procese de optimizare care identifică corelații în volume masive de date istorice. Ceea ce apare pe ecranul operatorului nu este o hartă a situației separată de opțiunile de acțiune, ci un tablou de bord cu recomandări ierarhizate în care reprezentarea și acțiunea sunt deja integrate. Aceasta înseamnă că precondiția separabilității identificată în secțiunea anterioară este absentă din arhitectura însăși a sistemului: operatorul nu primește o imagine a lumii pe care să o evalueze înainte de a primi recomandări, ci primește recomandările ca imagine a lumii.

A doua caracteristică este autoajustarea continuă a câmpului informațional. Aceste sisteme se ajustează continuu în funcție de rezultatele intervențiilor anterioare, reconfigurând câmpul informațional pe baza propriilor operațiuni. Această buclă de feedback face ca modelul să evolueze constant, ceea ce înseamnă că nici măcar o reconstituire retrospectivă completă a bazei epistemice nu este posibilă. Conceptul de „guvernamentalitate algoritmică” surprinde tocmai această dinamică: calculul statistic nu descrie realitatea, ci o produce, stabilind ce este vizibil, relevant și acționabil. Din perspectiva separabilității, consecința este că nu există un moment fix în care imaginea lumii poate fi izolată și examinată independent de procesul decizional.

A treia caracteristică privește efectul interfețelor asupra percepției operatorului. Tablourile de bord cu culori intuitive, scorurile procentuale și recomandările în limbaj direct produc o aparență de continuitate epistemică, adică impresia că operatorul vede o imagine a situației reale, când de fapt vede rezultatul procesării acelei situații prin filtrele specifice ale sistemului. Această prezentare grafică maschează absența separabilității: operatorul nu experimentează o ruptură între a înțelege situația și a primi recomandări, ci percepe recomandarea ca pe o consecință naturală a unei înțelegeri pe care crede că o deține. La nivel de ecran, statul pare că guvernează o imagine coerentă, dar această coerență este un artefact vizual al unei proceduri de calcul ascunse, nu o cunoaștere reală, contestabilă și legitimă a lumii.

O obiecție importantă trebuie examinată la acest punct. Cercetarea în domeniul explicabilității algoritmice a produs instrumente care pot oferi justificări post-hoc pentru recomandări individuale. Un modul tehnic poate indica ce variabile au contribuit la un scor de risc, oferind astfel o formă de transparență. Totuși, explicabilitatea post-hoc diferă structural de justificarea intersubiectivă necesară în contextele democratice. O analiză automată care arată unui funcționar că o anumită variabilă a influențat scorul final într-o anumită proporție nu oferă o bază reală pentru contestare democratică de substanță. Un astfel de instrument tehnic nu poate înlocui capacitatea unui cetățean sau a unui avocat de a interoga o persoană responsabilă cu privire la motivele etice, contextuale și politice pentru care anumite criterii au fost prioritizate în detrimentul altora. Diferența esențială este că întrebarea „ce altă informație de context ar fi putut schimba radical această decizie, dar a fost structural ignorată de model?” nu mai are un interlocutor instituțional competent. Nici dezvoltatorul comercial al software-ului nu poate anticipa întotdeauna greutatea exactă a fiecărui factor în deciziile emergente ale unei rețele complexe. Sistemul informatic nu poate purta un dialog în modul în care un expert uman poate fi provocat să își apere premisele. Explicabilitatea algoritmică poate reconstitui parțial logica unei recomandări specifice, dar nu poate reconstitui câmpul complet al opțiunilor epistemice pe care sistemul l-a configurat. Prin urmare, ea nu restaurează separabilitatea în sensul relevant pentru controlul democratic.

Trei cazuri din practica recentă ilustrează nu opacitatea sau discriminarea algoritmică în sine, care sunt deja documentate în literatura existentă, ci tocmai pierderea separabilității și a fricțiunii instituționale pe care le analizăm.

Primul provine din justiția penală americană, unde sistemul COMPAS a fost integrat în procesul decizional al instanțelor. Sistemul solicită completarea unui chestionar extins despre istoricul inculpatului și generează un scor de la unu la zece care indică riscul de recidivă. Magistratul primește acest scor gata prelucrat, fără acces la formula matematică din spatele său, aceasta fiind protejată ca secret comercial. O investigație jurnalistică din 2016 a analizat mii de dosare și a dezvăluit că, deși modelul interzicea explicit utilizarea apartenenței rasiale ca variabilă directă, rezultatele erau masiv distorsionate în defavoarea populației afro-americane. Inculpații de culoare care nu au recidivat ulterior aveau o probabilitate aproape dublă, comparativ cu inculpații caucazieni, de a fi catalogați eronat drept indivizi cu risc ridicat. Ceea ce este relevant pentru argumentul nostru nu este discriminarea ca atare, ci faptul că instanțele care utilizau sistemul nu dispuneau de o reprezentare intermediară a situației inculpatului separabilă de scorul de risc. Judecătorul nu primea o imagine a lumii pe care să o evalueze și pe baza căreia să decidă, ci un scor care fuziona reprezentarea și recomandarea. Contestarea scorului presupunea contestarea întregului sistem, nu a unei judecăți specifice.

Al doilea caz provine din administrația socială olandeză, unde sistemul SyRI scana preventiv cartiere întregi, preponderent pe cele cu populație vulnerabilă, construind modele de risc comportamental prin încrucișarea unor volume masive de date personale din registre fiscale, de asistență socială, de proprietate și de sănătate. O coaliție de organizații pentru drepturile civile a acționat statul olandez în judecată. În fața instanței, a devenit clar că nici măcar entitățile guvernamentale beneficiare nu puteau explica mecanica internă a modului în care o persoană ajungea să fie desemnată ca prezentând risc ridicat de fraudă. Pierderea separabilității era completă: instituția nu putea identifica pe baza cărei imagini a lumii luase deciziile care afectau drepturi fundamentale. Gravitatea acestei abordări s-a materializat și mai concret într-un scandal conex privind alocațiile pentru creșterea copilului, în care un algoritm de profilare a luat în considerare în mod discriminatoriu naționalitatea multiplă a părinților ca factor de risc. Zeci de mii de familii au fost acuzate pe nedrept de fraudă și li s-a ordonat să returneze statului sume considerabile. Mii de părinți au intrat în faliment personal, locuințe au fost pierdute, iar peste o mie de copii au ajuns în grija statului din cauza incapacității financiare bruște a familiilor lor. O comisie parlamentară a concluzionat că principiile statului de drept au fost încălcate flagrant, iar întregul cabinet guvernamental și-a prezentat demisia.

Al treilea caz, poate cel mai elocvent pentru argumentul nostru, provine din Regatul Unit. Începând cu finalul anilor nouăzeci, Poșta Britanică a impus un sistem contabil dezvoltat de compania Fujitsu, numit Horizon. Sistemul conținea erori de programare care generau discrepanțe financiare complet iluzorii în contabilitatea agențiilor poștale locale. Sume importante păreau să dispară din casierii, doar pe ecranele sistemului informatic, deși banii fizici nu fuseseră niciodată pierduți. Când sub-directorii de poștă au raportat disfuncționalitățile, reacția instituției centrale a fost tipică pentru regimul dependenței epistemice: conducerea corporativă a investit o încredere absolută în logica sistemului și a refuzat să accepte mărturiile oamenilor din teren. Pornind de la premisa că algoritmul contabil are întotdeauna dreptate, Poșta a declanșat urmărirea penală a propriilor angajați. Sute de oameni nevinovați au fost judecați și condamnați pentru furt și fraudă exclusiv pe baza rapoartelor generate de sistem. Funcționari cinstiți au fost închiși, și-au pierdut reputația, au intrat în faliment personal. A fost nevoie de aproape două decenii de campanii civice conduse de foștii angajați și de jurnaliști de investigație până când justiția britanică a recunoscut public că sistemul Horizon conținea defecte structurale, iar datele furnizate erau invalide. Acest caz este deosebit de relevant pentru analiza noastră, deoarece ilustrează nu doar pierderea separabilității, ci și eliminarea completă a fricțiunii instituționale: instituția a ales sistematic să creadă sistemul împotriva mărturiilor umane, iar mecanismele interne de corecție au fost complet anulate de autoritatea epistemică acordată instrumentului tehnic.

Aceste trei cazuri nu sunt deviații izolate, ci manifestări ale mecanismului structural descris mai sus. Rezultatul direct al integrării tehnologice fără salvgardări epistemice adecvate este o guvernare în care imaginea lumii nu dispare cu totul, dar devine indisponibilă ca obiect distinct de contestare. Statul continuă să dețină volume imense de date și să producă analize complexe, dar procesul prin care un rând de date este ridicat la rangul de analiză și analiza dictează decizia nu mai trece printr-o reprezentare separabilă și vizibilă, interogabilă din exterior. Mecanismul descris în această secțiune produce consecințe care se manifestă pe mai multe paliere. Secțiunea următoare le analizează sistematic, incluzând și dimensiunea care completează circuitul: efectul algoritmilor asupra celuilalt capăt, cel al cetățeanului.

4. Consecințele dependenței epistemice și închiderea circuitului democratic

Mecanismul descris în secțiunea anterioară, pierderea separabilității dintre reprezentare și decizie prin funcționarea normală a sistemelor algoritmice predictive, produce consecințe care se cumulează pe patru paliere distincte, dar interconectate: palierul instituțional, prin dispersarea responsabilității și atrofia capacității analitice; palierul democratic, prin erodarea justificabilității publice și instaurarea veridicției computaționale; palierul geopolitic, prin transformarea dependenței epistemice în vulnerabilitate strategică; și palierul societal, prin modelarea algoritmică a percepțiilor și preferințelor cetățenilor, care completează închiderea circuitului. Argumentul central al acestei secțiuni este că dependența epistemică nu este doar cumulativă, ci bilaterală: ea afectează simultan ambele capete ale circuitului democratic, iar tocmai această bilateralitate transformă riscul epistemic într-un risc sistemic.

Pe palierul instituțional, prima consecință este asimetria dintre responsabilitate și constrângere. Decizia rămâne semnată de un om. Niciun sistem de analiză predictivă nu preia formal autoritatea decizională. Operatorul uman apasă butonul final. Responsabilitatea este juridică. Constrângerea este epistemică. Înainte ca operatorul să deschidă ecranul, sistemul a selectat deja ce este vizibil, a ierarhizat ce este urgent, a filtrat ce corelații sunt semnificative. Decidentul lucrează asupra unui mediu cognitiv prestructurat. Poate refuza o recomandare specifică. Nu poate accesa ceea ce sistemul nu a considerat relevant. Și nu poate ști că nu vede ceea ce nu vede. Capacitatea de a stabili ce devine vizibil și ce rămâne invizibil pe ecranul unui operator, de a determina printr-un scor ce problemă socială este relevantă și ce realitate poate fi neglijată, constituie o formă de putere structurală. Această putere nu este deținută conștient de un actor identificabil. Ea este distribuită în arhitectura sistemului, în alegerea seturilor de date folosite pentru antrenament și în funcțiile de optimizare. Tocmai de aceea mecanismele tradiționale ale democrației constituționale, concepute pentru a limita abuzurile comise cu intenție directă de actori umani identificabili, sunt insuficiente în fața acestei noi forme de putere.

Această asimetrie produce un model de guvernare în care responsabilitatea se dispersează structural. Dacă decizia se dovedește greșită, decidentul poate invoca că a urmat cea mai bună informație disponibilă. Furnizorul poate invoca că sistemul a funcționat conform specificațiilor. Nimeni nu este formal responsabil pentru configurarea câmpului decizional care a făcut ca acea decizie să pară cea mai rațională. Între aceste puncte se deschide un spațiu de iresponsabilitate structurală care nu rezultă din reaua-credință a niciunui participant, ci din arhitectura relației dintre decident, sistem și furnizor.

A doua consecință pe palierul instituțional este atrofia capacității analitice. Mecanismul este analog cu un mușchi care nu mai este utilizat. Cu fiecare an în care un sistem de suport decizional preia sarcinile de interpretare a cazurilor complexe, competențele analitice profunde ale funcționarilor publici se erodează prin lipsă de exercițiu. Oamenii care erau obișnuiți să evalueze un caz cu toate nuanțele sale se obișnuiesc să citească exclusiv procente de probabilitate. Procedurile birocratice se ajustează la logica sistemului, iar criteriile de evaluare a funcționarilor devin similare cu metricile de optimizare ale programului. Experții maturi care dețineau cunoaștere tacită, experiențială și bazată pe raționament clinic părăsesc instituția. Tinerii funcționari care le iau locul sunt formați în umbra ecranului, învățând să execute deciziile sugerate de algoritmi fără a mai avea aparatul conceptual necesar pentru a le chestiona acuratețea. La suprafață, statul pare mai rapid și mai eficient. La nivel de fundament, instituția devine inertă din punct de vedere cognitiv. Când o criză neașteptată lovește sau sistemul devine indisponibil, statul descoperă că a delegat nu doar munca de rutină, ci însăși capacitatea de a înțelege și diagnostica lumea reală.

Pe palierul democratic, consecința centrală este erodarea justificabilității publice, amplificată de procesul de veridicție computațională descris în secțiunea a doua. Decidentul trebuie să poată explica nu doar ce a decis, ci pe baza cărei înțelegeri a situației a decis. Dacă această înțelegere este produsul unei procesări algoritmice a cărei logici nu o poate articula contestabil, justificarea publică se reduce la un exercițiu retoric. Legătura cu precondiția identificată în secțiunea a doua este directă: separabilitatea dintre reprezentare și decizie nu este doar o condiție a controlului democratic extern, ci și o condiție a justificării democratice interne. Un guvern care nu poate reconstitui imaginea lumii pe baza căreia a decis nu poate satisface cerința de justificabilitate publică, indiferent cât de corectă s-ar dovedi retrospectiv decizia luată. Iar un cetățean căruia i se comunică un scor de risc fără posibilitatea de a interoga premisele acelui scor este lipsit nu doar de un drept procedural, ci de resursele epistemice necesare pentru a-și exercita calitatea de subiect al democrației.

Pe palierul geopolitic, dependența epistemică se transformă în vulnerabilitate strategică. Literatura despre suveranitatea digitală s-a concentrat, până recent, pe controlul asupra datelor, proprietatea infrastructurii fizice și independența față de furnizori. Analiza a fost extinsă ulterior pentru a include dependența contractuală de furnizori externi ca vector de vulnerabilitate. Articolul de față propune o a treia dimensiune, mai profundă: dependența epistemică ca pierdere de suveranitate la nivelul configurării câmpului decizional.

Dacă un stat european integrează sisteme algoritmice predictive dezvoltate și operate de entități din jurisdicții terțe, pierderea de suveranitate nu se produce în primul rând prin accesul la date. Ea se produce la nivelul criteriilor prin care sistemul stabilește ce este relevant, ce constituie un risc, ce opțiuni sunt acționabile. Entitățile care dețin infrastructura cognitivă câștigă o capacitate de influență structurală asupra celor care nu o dețin. Aplicat la statul ca actor, argumentul implică faptul că un stat care externalizează funcția de configurare a câmpului decizional, chiar și fără intenție și fără o decizie politică explicită, cedează o formă de suveranitate care nu este recuperabilă prin instrumente clasice de politică externă sau de securitate cibernetică. Un guvern care dispune de toate datele cetățenilor, care operează legal pe propriile servere un sistem de clasificare avansat, dar care a pierdut controlul analitic asupra criteriilor ascunse de selecție și asupra modului în care informațiile devin pertinente din punct de vedere decizional, nu este un stat lipsit de tehnologie. Este un stat vulnerabil din punct de vedere sistemic la erori pe care nu are cum să le anticipeze și pe care nu știe cum să le deconstruiască.

Această dimensiune este cu atât mai importantă în contexte adversariale. Un actor care înțelege logica de configurare a câmpului decizional al unui adversar dobândește un avantaj strategic: capacitatea de a anticipa ce opțiuni adversarul nu va vedea. Dependența epistemică nu este, prin urmare, doar o problemă de guvernanță internă. Este o problemă de securitate națională și de reziliență strategică.

Pe palierul societal, analiza ajunge la o dimensiune care completează circuitul și transformă calitativ natura riscului. Secțiunile anterioare au examinat dependența epistemică la capătul decizional al circuitului democratic. Dar democrația presupune că și celălalt capăt funcționează: cetățenii trebuie să fie capabili să formeze judecăți politice relativ autonome, pe baza unor informații accesibile și a unei deliberări autentice. Această condiție este ea însăși erodată de infrastructurile algoritmice care mediază accesul cetățenilor la informație, la discursul public și la formarea opiniilor.

Sistemele de recomandare, targetare și amplificare algoritmică funcționează pe o logică de optimizare a angajamentului: ele nu filtrează informația în funcție de relevanța ei civică, ci în funcție de capacitatea ei de a capta și menține atenția utilizatorului. Consecința este o prestructurare sistematică a câmpului perceptiv și afectiv al cetățeanului. Ce subiecte devin vizibile, ce cadre de interpretare sunt amplificate, ce emoții sunt stimulate, ce perspective sunt marginalizate, toate acestea sunt determinate de algoritmi de optimizare a căror logică este la fel de opacă și de inaccesibilă contestării ca și cea a sistemelor predictive folosite de stat.

Această prestructurare are trei efecte specifice asupra capacității cetățenilor de a funcționa ca agenți ai controlului democratic. Primul este fragmentarea spațiului public. Algoritmii de recomandare personalizează fluxul informațional al fiecărui utilizator, creând medii perceptive divergente în care cetățenii nu mai au acces la aceeași bază de fapte. Deliberarea democratică presupune un spațiu comun de referință, un set de fapte și interpretări partajate pe care cetățenii le pot dezbate. Personalizarea algoritmică erodează tocmai această bază comună.

Al doilea efect este amplificarea selectivă a anumitor cadre de interpretare. Algoritmii de recomandare tind să amplifice conținutul care generează reacții emoționale puternice, deoarece acesta maximizează angajamentul. Consecința nu este doar polarizarea opiniilor, ci distorsiunea sistematică a percepției asupra realității: anumite probleme sunt suprareprezentate, anumite narrative sunt amplificate disproporționat, iar complexitatea situațiilor reale este redusă la cadre simplificatoare care maximizează reacția, nu înțelegerea.

Al treilea efect este erodarea autonomiei epistemice a cetățeanului. Într-un mediu informațional în care expunerea la conținut este determinată de algoritmi de optimizare, cetățeanul nu mai accesează informația în funcție de propriile alegeri deliberate, ci în funcție de predicții algoritmice despre ce îi va capta atenția. Formarea opiniei politice, care în modelul democratic clasic presupune un act de judecată relativ autonom, devine ea însăși un proces mediat și prestructurat de logici computaționale opace.

Atunci când aceste trei efecte se suprapun pe dependența epistemică a statului descrisă în secțiunile anterioare, se produce ceea ce putem numi închiderea algoritmică a circuitului democratic. La un capăt, decidentul public operează într-un câmp cognitiv prestructurat de sisteme predictive care fuzionează reprezentarea cu recomandarea. La celălalt capăt, cetățeanul își formează judecățile politice într-un câmp informațional și afectiv modelat de sisteme de recomandare și amplificare. Consecința nu este dispariția formală a instituțiilor democratice, ci degradarea lor substanțială: mecanismele reprezentării, deliberării și contestării continuă să existe, dar funcționează într-un mediu ale cărui condiții de posibilitate sunt configurate din exteriorul controlului democratic.

Formulat cu precizie: cetățeanul riscă să fie scos din bucla efectivă a guvernării, chiar dacă rămâne inclus formal în procedurile ei. El continuă să voteze, să depună petiții, să participe la dezbateri publice. Dar atât formarea preferințelor care îi ghidează votul, cât și capacitatea de a evalua critic justificările oferite de putere sunt mediate de infrastructuri algoritmice pe care nici el, nici adesea statul nu le controlează. Bucla se închide: statul decide pe baza unor reprezentări pe care nu le poate contesta independent, iar cetățenii contestă pe baza unor percepții care sunt ele însele produsul unor sisteme de optimizare opace.

Această închidere nu trebuie înțeleasă ca un act deliberat de sabotaj al democrației. Ea este rezultatul convergenței a două procese independente: pe de o parte, integrarea sistemelor predictive în aparatul statal, pe de altă parte, medierea algoritmică a spațiului public. Niciunul dintre aceste procese nu a fost conceput cu scopul de a eroda democrația. Dar efectul lor combinat este tocmai acesta, iar faptul că nimeni nu l-a planificat nu îl face mai puțin real.

Este important să recunoaștem și limitele acestui argument. Nu toți cetățenii sunt afectați în mod egal de prestructurarea algoritmică. Nivelul de educație, diversitatea surselor de informare și participarea la comunități deliberative offline mediază semnificativ gradul de vulnerabilitate. De asemenea, manipularea percepțiilor publice nu este un fenomen nou: propaganda, dezinformarea și controlul mediatic au existat cu mult înainte de era digitală. Ceea ce este nou este scala, viteza, personalizarea și opacitatea procesului, precum și faptul că acesta funcționează simultan cu dependența epistemică a statului, creând o convergență fără precedent.

Cele patru paliere sunt conectate prin caracterul cumulativ și bilateral al dependenței epistemice, care are trei trăsături specifice ce o fac deosebit de dificil de detectat. Prima este absența simptomelor vizibile: sistemul funcționează, recomandările sunt coerente, deciziile sunt luate la timp, iar cetățenii continuă să participe la procesele democratice formale. Riscul epistemic nu declanșează niciun sistem de alarmă instituțională, deoarece nu ia forma unei disfuncții, ci se ascunde sub forma unei performanțe aparent ireproșabile. A doua este cumulativitatea: fiecare ciclu decizional adâncește dependența la capătul statal, iar fiecare ciclu de interacțiune cu infrastructurile informaționale adâncește prestructurarea la capătul cetățeanului. Inversarea devine progresiv mai costisitoare pe ambele fronturi. A treia este invizibilitatea instituțională: dependența nu face obiectul niciunui control democratic formal la niciunul dintre cele două capete, pentru că nu este codificată în nicio categorie administrativă existentă. Parlamentele votează bugete, comisiile evaluează conformitatea, curțile de conturi verifică legalitatea. Niciuna nu evaluează impactul asupra condițiilor în care decizia devine posibilă și nici asupra condițiilor în care contestarea democratică rămâne autentică. Riscul epistemic nu se încadrează în nicio categorie existentă, nefiind tehnic, juridic sau politic în sens convențional, ceea ce explică de ce instrumentele actuale de evaluare nu îl captează.

5. Cadrul de evaluare și principiile de răspuns instituțional

Analiza din secțiunile anterioare a identificat un risc specific, dependența epistemică structurală, ale cărui consecințe se manifestă pe palierele instituțional, democratic, geopolitic și societal, iar combinarea lor produce închiderea algoritmică a circuitului democratic. Această secțiune derivă din analiza respectivă un cadru de evaluare și patru principii de răspuns instituțional. Fiecare element al cadrului răspunde unei dimensiuni specifice a riscului identificat, iar principiile sunt formulate ca răspunsuri directe la mecanismele de erodare descrise. Cadrul propus vizează în primul rând capătul decizional al circuitului, unde statul dispune de instrumente directe de intervenție, dar ia în considerare și implicațiile închiderii circuitului la capătul societal.

Înainte de a prezenta cadrul propus, este important să clarificăm de ce instrumentele existente sunt insuficiente. Metodele actuale de evaluare nu sunt deficitare, ci proiectate pentru alte întrebări. Auditul tehnic verifică funcționarea conform specificațiilor. Evaluarea de securitate verifică protecția împotriva atacurilor. Evaluarea de conformitate, inclusiv cea prevăzută de legislația europeană pentru sistemele cu risc înalt, verifică respectarea cerințelor privind transparența și explicabilitatea. Niciuna nu pune întrebarea centrală din perspectiva autonomiei instituționale: odată ce această arhitectură predictivă va fi complet integrată în fluxurile decizionale, ce porțiune a realității sociale va înceta să mai poată fi contestată democratic și ce anume va fi sustras posibilității unei evaluări umane independente? Și niciuna nu pune întrebarea complementară: în ce măsură integrarea acestor sisteme, corelată cu medierea algoritmică a spațiului public, afectează capacitatea cetățenilor de a funcționa ca agenți autentici ai controlului democratic? Această lacună nu este accidentală, ci reflectă absența categoriei de risc epistemic structural din cadrele de evaluare existente. Legile actuale se preocupă de abuzul de putere realizat cu intenție de actori umani, nu de pierderea cognitivă treptată pe care statul o acceptă printr-un proces tehnic de achiziții publice și pe care societatea o suportă printr-o mediare informațională a cărei logică nu o alege.

Cadrul de evaluare propus acoperă cinci domenii, fiecare derivat din analiza anterioară și fiecare cu întrebări specifice care pot primi răspunsuri documentate înainte de semnarea unui contract de achiziție.

Primul domeniu privește vizibilitatea și excluderea. El răspunde direct mecanismului descris în secțiunea a treia, prin care sistemul prestructurează câmpul decizional fără a documenta ce anume a exclus. Întrebările esențiale sunt: poate sistemul să documenteze explicit ce categorii de date exclude și pe baza căror criterii? Poate operatorul să solicite vizibilitate asupra opțiunilor neincluse în recomandări? Sunt criteriile de ierarhizare accesibile instituțional, nu doar tehnic?

Al doilea domeniu privește reprezentarea intermediară. El răspunde direct pierderii separabilității dintre reprezentare și recomandare, identificată ca mecanism central al erodării. Întrebările sunt: produce sistemul o reprezentare intermediară accesibilă decidentului și separabilă de recomandare? Există o procedură de contestare a modelului intern, distinctă de contestarea unei recomandări specifice? Această distincție este esențială, deoarece contestarea unui caz particular nu rezolvă imperfecțiunea sau discriminarea implementată la scara întregului model.

Al treilea domeniu privește capacitatea internă. El răspunde riscului de atrofie a capacității analitice descris pe palierul instituțional în secțiunea a patra. Întrebările sunt: dispune instituția de capacitate analitică suficientă pentru a formula alternative fără a utiliza sistemul ca referință? Există un plan explicit de menținere a acestei capacități pe durata contractului? Include contractul transfer de competențe analitice, nu doar de licențe? Un parteneriat cu un furnizor de tehnologie trebuie să presupună un transfer continuu de expertiză către corpul funcționarilor, asigurând că aceștia înțeleg pe ce baze judecă sistemul și evitând transformarea statului într-un simplu client care închiriază accesul la o rețea neuronală.

Al patrulea domeniu privește auditabilitatea arhitecturală. El răspunde vulnerabilității geopolitice identificate pe palierul strategic, unde pierderea controlului asupra logicii de configurare a câmpului decizional echivalează cu cedarea unei forme de suveranitate. Întrebările sunt: poate instituția să comande un audit independent al logicii de configurare a câmpului decizional, fără acordul prealabil al furnizorului? Sunt modificările arhitecturale notificate obligatoriu și supuse aprobării instituționale? Invocarea secretului comercial nu poate constitui un blocaj absolut în fața controlului statal atunci când sunt în joc decizii care afectează drepturi fundamentale.

Al cincilea domeniu privește reversibilitatea. El răspunde caracterului cumulativ al dependenței epistemice și necesității de a preveni situații în care inversarea devine prohibitiv de costisitoare. Întrebările sunt: există o clauză de ieșire care garantează reconstituirea capacității autonome în termene definite? A fost evaluat costul de tranziție nu doar financiar, ci și cognitiv și operațional?

Un criteriu orientativ pentru pragul de risc: dacă întrebările esențiale din primele patru domenii nu pot primi răspuns documentat și verificabil înainte de semnarea contractului, achiziția prezintă risc de dependență epistemică structurală, un risc care nu poate fi acoperit prin clauze standard de securitate sau conformitate. Pragul nu este fixat numeric, pentru că gravitatea depinde de contextul instituțional specific, dar absența de răspuns într-un domeniu complet indică deja o vulnerabilitate semnificativă.

Patru principii de răspuns instituțional derivă din aceeași analiză. Fiecare principiu răspunde unei dimensiuni specifice a problemei și, luate împreună, ele oferă o structură minimală de protecție a autonomiei epistemice.

Primul principiu este menținerea capacității analitice interne ca prioritate strategică, nu ca redundanță costisitoare. Acest principiu răspunde direct mecanismului de atrofie descris pe palierul instituțional. Orice economie realizată prin externalizarea funcției analitice trebuie evaluată în raport cu costul pierderii capacității de evaluare independentă, un cost care nu este vizibil pe termen scurt, dar care devine determinant în momente de criză.

Al doilea principiu este separabilitatea dintre reprezentare și recomandare. Acest principiu răspunde direct mecanismului central de erodare identificat în secțiunea a treia. Ori de câte ori este posibil tehnic, sistemele ar trebui configurate să producă o reprezentare intermediară, accesibilă și contestabilă, înainte de a genera recomandări. Această separabilitate recrează în interiorul sistemului algoritmic precondiția esențială a guvernării democratice: posibilitatea de a contesta imaginea lumii pe baza căreia se ia o decizie, oferind un punct de oprire și informare în care fricțiunea instituțională se poate exercita.

Al treilea principiu este transparența arhitecturală ca cerință de suveranitate. Acest principiu răspunde vulnerabilității geopolitice identificate pe palierul strategic. Statul trebuie să aibă acces nu doar la date și recomandări, ci la logica de configurare a câmpului decizional, într-o formă care să permită interogarea instituțională a criteriilor prin care sistemul stabilește ce este relevant, ce este risc și ce este acționabil. Aceasta depășește cerințele de transparență individuală prevăzute de legislația europeană și vizează un nivel arhitectural mai profund.

Al patrulea principiu este reversibilitatea ca condiție contractuală și strategică. Acest principiu răspunde caracterului cumulativ al dependenței epistemice și necesității de a menține permanent posibilitatea ieșirii. Orice contract ar trebui să includă un plan de dezintegrare cu termene definite, iar costul reversibilității, financiar, operațional și cognitiv, ar trebui calculat în evaluarea inițială. Condiția reversibilității nu este un instrument de negociere comercială. Este o condiție a suveranității.

Aceste principii nu implică respingerea inovațiilor sau suspendarea inițiativelor care angrenează analize algoritmice avansate. Cerința este una de luciditate instituțională: capacitatea de a moderniza administrația și de a beneficia de performanța sistemelor inteligente, menținând simultan salvgardările epistemice necesare pentru protecția cetățeanului și a democrației.

O observație finală privind limitele acestui cadru în raport cu dimensiunea societală a problemei. Cadrul de evaluare propus vizează în mod direct capătul decizional al circuitului democratic, unde statul dispune de instrumente concrete de intervenție, prin politici de achiziție, standarde de auditare și cerințe contractuale. Capătul societal, cel al prestructurării algoritmice a percepțiilor și preferințelor cetățenilor, este mai dificil de adresat prin aceleași instrumente. El necesită politici publice distincte privind transparența algoritmilor de recomandare, reglementarea targetării informaționale, protecția spațiului deliberativ public și investiția în educația epistemică a cetățenilor. Aceste politici depășesc scopul prezentului articol, dar trebuie recunoscute ca necesare pentru o abordare completă. Fără ele, chiar și o protecție perfectă a autonomiei epistemice a statului rămâne insuficientă, deoarece celălalt capăt al circuitului democratic continuă să fie erodat.

6. Concluzii

Articolul a urmărit un argument în patru pași. Primul pas a stabilit că separabilitatea dintre reprezentarea realității și decizia de acțiune constituie o precondiție epistemică a controlului democratic, protejată în practică de fricțiunea instituțională și amenințată de nedreptatea epistemică și de veridicția computațională. Al doilea pas a demonstrat că funcționarea normală a sistemelor algoritmice predictive erodează tocmai această separabilitate, prin fuziunea dintre model și recomandare, autoajustarea continuă a câmpului informațional și efectul interfețelor asupra percepției operatorului. Al treilea pas a arătat că această erodare produce consecințe cumulative pe patru paliere: dispersarea responsabilității și atrofia capacității analitice pe plan instituțional, erodarea justificabilității publice pe plan democratic, transformarea dependenței epistemice în vulnerabilitate strategică pe plan geopolitic și, pe plan societal, prestructurarea algoritmică a percepțiilor și preferințelor cetățenilor, care completează închiderea circuitului democratic. Al patrulea pas a derivat din această analiză un cadru de evaluare și patru principii de răspuns instituțional.

Constatarea centrală este că riscul identificat, dependența epistemică structurală, nu este doar unilateral, ci bilateral. El afectează simultan ambele capete ale circuitului democratic: decidentul public operează într-un câmp cognitiv prestructurat de sisteme predictive, iar cetățeanul își formează judecățile politice într-un câmp informațional și afectiv modelat de sisteme de recomandare și amplificare. Democrația nu este anulată în sens formal, deoarece instituțiile, alegerile și procedurile continuă să existe. Dar ea riscă să fie golită de conținut prin închiderea algoritmică a ambelor capete: atât producerea deciziei, cât și producerea contestării ei devin mediate de logici computaționale opace, pe care nici statul, nici cetățenii nu le controlează efectiv.

Acest risc nu este captat de niciuna dintre categoriile existente de audit sau control democratic. El nu rezultă din intenția niciunui actor, nu se manifestă ca disfuncție și nu produce simptome vizibile în funcționarea curentă a sistemului. Tocmai de aceea este deosebit de dificil de diagnosticat și de adresat prin instrumentele existente.

Cadrul de evaluare și cele patru principii propuse răspund acestei lacune la capătul decizional al circuitului. Ele nu sunt suficiente prin ele însele, iar implementarea lor presupune voință politică, competențe instituționale și resurse. Dar ele sunt necesare ca punct de plecare, pentru că oferă o structură prin care o problemă difuză poate fi transformată într-un set de întrebări concrete și verificabile. Protecția capătului societal necesită politici publice complementare privind transparența algoritmilor de recomandare, reglementarea targetării informaționale și investiția în educația epistemică a cetățenilor, politici care depășesc scopul acestui articol dar care sunt indispensabile pentru o abordare completă.

Analiza prezintă și limite care trebuie recunoscute. Articolul nu tratează mecanismele prin care statele ar putea dezvolta capacitate algoritmică proprie fără a reproduce aceleași riscuri epistemice. Nu examinează nici diferențele semnificative dintre domenii: dependența epistemică în domeniul militar are un profil de risc diferit de cea din administrația socială sau din justiție. Nu abordează dimensiunea temporală a tranziției: cum gestionează o instituție perioada în care reduce dependența de un sistem fără a pierde capacitățile pe care acesta le oferă. Iar analiza palierului societal rămâne schematică și ar necesita o investigație proprie, care să examineze în detaliu interacțiunea dintre veridicția computațională, manipularea cognitivă algoritmică și alte forme de producere a adevărului în societățile contemporane.

Aceste limitări deschid direcții de cercetare care rămân necesare. Ele nu diminuează însă forța constatării de bază. Guvernarea fără imagine a lumii nu este o guvernare care nu funcționează. Este o guvernare care funcționează fără a mai avea acces la precondițiile propriei legitimități democratice. Ea continuă să ia decizii, să aloce resurse, să gestioneze crize. Dar nu mai poate garanta că procesul prin care aceste decizii sunt luate poate fi reconstituit, contestat și corectat de către cei în numele cărora se guvernează. Iar cetățenii în numele cărora se guvernează operează ei înșiși într-un mediu perceptiv care le prestructurează judecățile, le fragmentează solidaritatea și le erodează autonomia epistemică. Problema nu este cine apasă butonul. Problema nu este nici măcar dacă butonul mai există. Problema este dacă cel care ar putea să îl apese mai are acces la o înțelegere a lumii care nu a fost deja configurată de sistemul pe care ar trebui să îl controleze.

Leave a Reply