Context temporal și factual inițial

Alegerile prezidențiale din România din noiembrie 2024 au înregistrat o schimbare fără precedent în istoria democratică recentă a țării. La 24 noiembrie 2024, cetățenii români au participat la primul tur al scrutinului pentru alegerea președintelui. Rezultatele au evidențiat o ascensiune spectaculoasă a unui candidat independent, Călin Georgescu, care a obținut 22,94% din totalul voturilor și s-a clasat pe primul loc, calificându-se astfel pentru turul al doilea[35][36]. Această performanță electorală a reprezentat o surpriză majoră pentru analiștii politici, mai ales că, cu doar trei săptămâni înainte de alegeri, același candidat era creditat în sondajele de opinie cu mai puțin de 1% din preferințele alegătorilor[40].

Cu doar două zile înainte de turul al doilea, pe 6 decembrie 2024, Curtea Constituțională a României a anunțat în unanimitate anularea întregului proces electoral[9]. Motivarea hotărârii nr. 32/2024 afirma că procesul electoral a fost „viciat pe toată durata desfășurării sale”, că alegătorii au fost „dezinformați prin intermediul unei campanii electorale în care unul dintre candidați a beneficiat de o promovare agresivă, derulată cu eludarea legislației naționale în domeniul electoral și prin exploatarea abuzivă a algoritmilor platformelor de social media”[37]. Hotărârea constituțională a dispus reluarea întregului scrutin în condiții de transparență și corectitudine democratică[62].

Această secvență de evenimente ridică întrebări fundamentale privind mecanismele prin care informațiile distorsionate se propagă în spațiul public și influențează comportamentul electoral la nivel de populație. Această analiză examinează alegerile prezidențiale din 2024 din perspectiva cadrului NATO privind razboiul cognitiv și a metodologiei DISARM pentru evaluarea campaniilor de dezinformare, cu accent pe prejudecățile cognitive exploatate și pe mecanismele algoritmice de amplificare mobilizate pe parcursul acelei perioade.

Cadrul NATO: razboiul cognitiv ca dimensiune a amenințării hibride

Între 2023 și 2024, NATO ACT (Allied Command Transformation) a dezvoltat un concept exploratoriu dedicat noilor forme de amenințări: războiul cognitiv[1][2]. Această metodologie definește războiul cognitiv drept o operațiune de influență care urmărește perturbarea proceselor decizionale ale adversarului, eroziunea încrederii în instituții și exploatarea narativelor identitare preexistente, în scopul slăbirii voinței de rezistență și fragmentării coeziunii sociale[2].

Conform cadrului NATO, războiul cognitiv operează pe patru direcții strategice fundamentale[2]. Prima direcție vizează perturbarea semnificativă a proceselor decizionale prin interferența asupra ciclului de acțiune deliberativă (Observare-Orientare-Decizie-Acțiune), care reprezintă mecanismul esențial prin care factorii de decizie procesează informații și formulează concluzii raționate. Dezinformarea introduce incertitudine pe multiple niveluri cognitive, transformând contextul informațional într-un labirint de adevăruri și falsuri dificil de navigat pentru decidenți. A doua direcție se referă la fragmentarea și polarizarea societății, prin care adversarii exploatează narativele preexistente de conflict pentru a acutiza rupturi sociale și instituționale. A treia direcție implică exploatarea identităților și narativelor pentru a mobiliza adeziunea tribală în jurul unor formule politice sau personaje. A patra direcție urmărește subminarea voinței de rezistență prin dezmoralizare și pierderea încrederii în instituții și în viitorul colectiv[2].

Cazul României din 2024 reprezintă un exemplu elocvent al aplicării acestor patru direcții în context electoral. Perturbarea proceselor decizionale s-a manifestat prin creșterea exponențială a dezinformării pe platformele digitale în perioada septembrie-noiembrie. Polarizarea socială s-a accentuat pe baza narativei „România supusă” versus „România suverană”. Exploatarea identității s-a realizat prin apeluri la „adevărații români care luptă pentru țară” versus „sistemul corupt occidentalizat”. Subminarea încrederii în instituții s-a produs prin susținerea unui discurs care îl poziționa pe candidatul independent drept unicul salvator al țării[40].

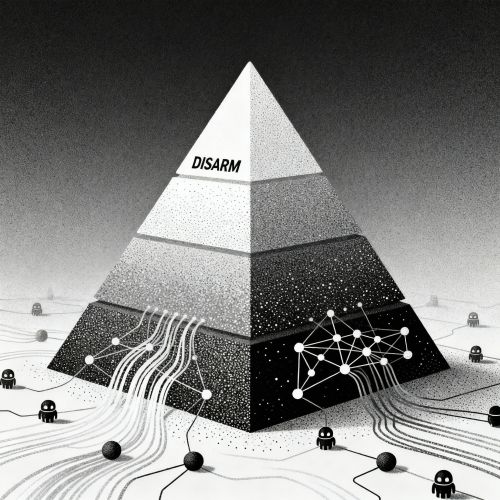

Cadrul DISARM: structura operațiunilor de interferență în informații

Hybrid Centre of Excellence din Finlanda a elaborat între 2019 și 2022 cadrul DISARM (DISinformation Analysis & Risk Management), care clasifică operațiunile de interferență străină în domeniul informațional pe patru niveluri ierarhice[5][6]. Piramida DISARM ordonează și clasifică activitatea de manipulare de la obiectivele strategice corespunzătoare campaniilor multianuale până la implementarea tactică, care se concretizează la nivel de conținut individual[4].

La nivelul cel mai înalt, campania strategică ține de scopurile multianuale ale unui actor ostil, cum ar fi destabilizarea geopolitică a unei țări, slăbirea coeziunii unei alianțe militare sau promovarea unui lider preferat. Nivelul al doilea, incidentul tactic, se referă la operațiuni de scurtă durată cu obiective specifice, cum ar fi promovarea unui candidat politic în perioada unei competiții electorale. Nivelul al treilea cuprinde narațiunile, respectiv poveștile și mesajele care structurează percepția și reacțiile emoționale ale publicului. Nivelul al patrulea include artefactele, adică postările individuale, videoclipurile, conturile de rețele sociale și mesajele care alcătuiesc substanța conținutului consumat de populație[5].

Aplicând modelul DISARM la cazul Georgescu din 2024, stratificarea operațiunilor relevă o orchestrare coordonată. La nivel de campanie, obiectivul era destabilizarea geopolitică a României prin eroziunea legitimității NATO și promovarea unui candidat pro-suveranist. La nivel de incident, promovarea candidatului independent pe TikTok și alte platforme în perioada noiembrie-decembrie reprezenta operațiunea tactică concretă. La nivel narativ, metanarațiunea „România supusă versus România suverană” a structurat emoțional mesajele transmise. La nivel de artefacte, 73,2 milioane de vizualizări pe eticheta #CălinGeorgescu, peste 130 de conturi coordonate de influenceri și 27.217 conturi bot active în postarea de comentarii sintetizau implementarea la bază[30][31][32].

Teoria controlului reflexiv și mecanismul dezinformării orientate

Teoria militară a dezvoltat, în epoca Războiului Rece, conceptul de „control reflexiv” ca strategie de a furniza informații selectate unui adversar, în scopul de a-l determina să ia decizii care favorizează inițiatorul[53][56]. Diferența esențială dintre controlul reflexiv și dezinformarea obișnuită constă în faptul că victima ia o decizie pe care o percepe ca fiind liberă și rațională, dar care corespunde exact scopului agresorului.

În contextul alegerilor românești, mecanismul controlului reflexiv s-a manifestat prin furnizarea de informații construite strategic, care au condus la decizii de vot aparent independente, dar de fapt orchestrate. Alegătorii au votat pentru Georgescu pe baza impresiei că îl aleg liber, în temeiul unor informații care le-au fost servite constant prin algoritmi și conturi coordonate. În realitate, fluxul informațional a reprezentat execuția unui plan de manipulare cognitivă. Conform raportului serviciilor, privind interferențele în informații, rețeaua de 27.199 conturi TikTok, activate cu doar una-două săptămâni înainte de alegeri pentru promovarea candidatului Georgescu și a unui partid politic, constituie o manifestare directă a controlului reflexiv[7]. Alegătorii credeau că aleg candidatul în temeiul convingerii proprii, dar în realitate erau expuși unui flux informațional artificial și masiv.

Prejudecați cognitive exploatate în campania electorală din 2024

Cercetarea psihologică occidentală a identificat o serie de prejudecăți cognitive (biasuri) sistematice care distorsionează judecata și procesarea informațiilor în situații complexe de luare a deciziilor. Alegerile prezidențiale, prin natura lor incertă și prin volumul masiv de informații contradictorii, reprezintă un context ideal pentru activarea acestor prejudecăți de către actorii care le cunosc și le exploatează strategic[43].

Prejudecata de confirmare (biasul de confirmare) descrie tendința de a căuta, interpreta și reține informații care validează credințele preexistente, în timp ce dovezile contradictorii sunt ignorate sau discreditate[11][48]. În cazul alegerilor din 2024, cetățenii care deja credeau că „NATO domină România” au căutat și au găsit ușor conținut pe TikTok care valida exact această convingere. Candidatul Georgescu, prin repetarea constantă a mesajelor suveraniste, a funcționat drept confirmare continuă a unui model de gândire deja existent. Mecanismul este subtil, deoarece platformele digitale, prin algoritmi, oferă selectiv utilizatorului conținut care activează prejudecata de confirmare, crescând implicarea utilizatorului și menținându-l pe platformă mai mult timp[58].

Prejudecata de disponibilitate (biasul de disponibilitate) descrie fenomenul prin care oamenii evaluează probabilitatea sau importanța unui eveniment proporțional cu cât de des aud referiri la acesta. Eticheta #CălinGeorgescu a generat 73,2 milioane de vizualizări în doar 23 de zile, iar conținutul pro-Georgescu a primit prioritate algoritmică pe TikTok, fiind etichetat drept „tendință emergentă”. Rezultatul direct a fost că oamenii l-au perceput pe Georgescu drept omul anului și candidatul inevitabil, nu pentru că această percepție era bazată pe realități politice obiective, ci pentru că îi auzeau numele menționat constant pretutindeni.

Efectul de iluzie a adevărului (iluzia adevărului) evidențiază că repetarea unei afirmații o face să pară mai adevărată, chiar și atunci când este falsă. Mesajele „România este supusă”, „Georgescu este singurul curat”, „NATO ne prejudiciază” au fost repetate de 130 de influenceri pe cinci platforme majore (TikTok, YouTube, Facebook, Telegram, WhatsApp) pe parcursul a 23 de zile, generând obișnuință mentală. Oamenii au ajuns să confunde familiaritatea cu adevărul și au votat pentru o percepție a realității construită prin repetare.

Prejudecata de grup (biasul de grup), cunoscută și ca favoritismul față de propriul grup, determină indivizii să favorizeze membrii grupului lor și să denigreze persoanele din afara acestuia[49][43]. Campania pro-Georgescu a construit o narațiune de grup: „noi, adevărații români care apărăm suveranitatea, versus ei, sistemul corupt, vânzătorii de țară”. Limbajul tribal și sloganele de tipul „noi salvăm, ei distrug” au activat mecanisme psihologice de loialitate față de grup, transformând votul dintr-o decizie rațională asupra politicilor într-o declarație de identitate tribală.

Prejudecata de autoritate (biasul de autoritate) descrie tendința psihologică de a căuta și de a aprecia autoritatea, ordinea și conducerea puternică în perioade de criză și incertitudine. Aceasta s-a activat în contextul unei crize economice reale, caracterizate prin inflație și pierderea puterii de cumpărare, și prin poziționarea lui Georgescu ca un lider „vertical” și autoritar, care va restabili ordinea[43][51]. Mesajul implicit era că sistemul democratic nu funcționează și că este necesară o conducere autoritară care sa impună o ordine strictă. Această dinamica este psihologic ușor de exploatat în perioadele de incertitudine economică și instituțională.

Prejudecata complexității (biasul de complexitate) descrie preferința umană pentru informații simple, care pot fi procesate rapid, în comparație cu informații complexe, ce necesită efort cognitiv. Mesajul lui Georgescu era simplu: „NATO rău, Georgescu bun”. Mesajul formațiunilor politice tradiționale era complex, implicând o analiză cost-beneficiu privind NATO și necesitatea adaptării la standardele europene. În contextul alegerilor pe TikTok, unde utilizatorii consumă conținut în formate video de 15-60 de secunde, mesajul simplu și polarizant câștigă întotdeauna[34][35].

Metanarațiunea și structura psihosocială a campaniei

Observatorii electorali și analiștii au identificat o structură psihosocială coordonată, care a susținut campania, desfășurată pe patru niveluri și având caracter emoțional-manipulator[38][39]. Această metanarațiune a funcționat ca un cadru unitar, integrând toate mesajele individuale și conferindu-le coerență și credibilitate.

Nivelul I definește PROBLEMA, enunțând o stare percepută de decădere. Mesajul transmis era că România este vândută Occidentului, NATO o domină, Uniunea Europeană îi impune reguli, serviciile secrete sunt agenți ai puterilor străine, clasa politică este coruptă, oligarhii controlează totul, iar poporul suferă. Aceste afirmații nu au fost susținute de dovezi empirice, ci au activat teama și frustrarea legitimă legate de criza economică și scăderea puterii de cumpărare, transformând acea frustrare într-o narațiune de conspirație și trădare.

Nivelul II identifică CAUZA, oferind o explicație sistematică a decăderii. Mesajul transmis a fost că sistemul politic este corupt, serviciile sunt acaparate de occident, iar clasa politică este criminală. Prin această formulă, complexitatea geopoliticii și a guvernanței a fost redusă la o vină personificată și externalizată, ușor de înțeles și emoțional rezonantă.

Nivelul III propune SOLUȚIA, prezentând mesianismul politic. Apare Călin Georgescu, descris drept liderul vertical, pur, neinfectat și outsider, care va salva România prin suveranitate. Această structură psihosocială exploatează dorința psihologică a oamenilor, în situații de criză, de a crede că există salvatori și de a externaliza responsabilitatea pentru soluție.

Nivelul IV transformă metanarațiunea în CHEMARE LA ACȚIUNE, un imperativ electoral. Mesajul transmis a fost: dacă nu votezi Georgescu, supunerea va continua, iar aceasta este ultima șansă. Această formulă a creat o urgență artificială și a polarizat alegerea în opțiuni binare simplificate, lăsând puțin spațiu pentru nuanțe sau compromisuri.

Integrarea coerentă a acestor patru niveluri în metanarațiunea unitară a avut efectul de a determina alegătorii să perceapă mesajele ca parte a unei realități coerente, chiar și atunci când erau contradictorii sau nefondate. Contestarea oricărei părți a metanarațiunii era percepută ca dovadă a conspirației, ceea ce a consolidat imunitatea socială a narațiunii la critică și a creat o structură de gândire care se autoproteja împotriva infirmării.

Amplificarea algoritmică și mecanismele platformelor digitale

Platforma TikTok a jucat un rol central în diseminarea și amplificarea exponențială a conținutului pro-Georgescu. Mecanismul de amplificare nu a fost nici o operațiune de voință editorială, nici un rezultat direct al unei comenzi externe, ci o consecință a modului în care algoritmii de recomandare ai TikTok funcționează, preferând conținuturile cu implicare emoțională ridicată[34][58].

TikTok utilizează algoritmi care prioritizează conținutul ce generează cel mai mare angajament, precum comentarii, aprecieri și distribuiri, indiferent de veridicitatea sau integritatea faptică a conținutului[36][34]. Cercetări realizate în instituții academice europene au demonstrat că conținutul polarizant și incendiator generează cu 40% mai mult angajament decât conținutul moderat[34]. Prin această logică algoritmică, mesajele pro-Georgescu, profund polarizante și emoționale, au fost amplificate exponențial de algoritm, fără necesitatea unei intervenții externe directe.

Cu toate acestea, rapoartele serviciilor arată că amplificarea nu a fost complet organică. Rețeaua formată din 27.217 conturi bot, activate simultan în lunile premergătoare alegerilor, a generat comentarii pe scară largă, creând iluzia unei tendințe emergente în cadrul algoritmului[7]. Această tehnică, de manipulare algoritmului, exploatează faptul că algoritmii nu fac distincție între comentariile autentice și cele sintetice, postate de boți. Prin postarea masivă și coordonată de comentarii, rețeaua de conturi false a crescut artificial semnalele care alimentează algoritmul, amplificând astfel conținutul.

Rezultatul combinat a fost o amplificare exponențială care nu putea fi atinsă doar prin efort uman. Conținutului pro-Georgescu i s-a acordat o vizibilitate disproporționată, iar opinia publică a fost expusă la o doză masivă de mesaje suveraniste și polarizante. Studiile privind impactul comportamentului electoral în context digital arată că expunerea repetată la mesaje coordonate și amplificate algoritmic are efect de creștere a intențiilor de vot pentru candidatul promovat[58][60].

Structura actorilor și orchestrarea operațiunii

Campania electorală din 2024 s-a caracterizat printr-o structură de actori multi-nivel și responsabilități difuze. La nivel strategic superior, serviciile de informații ale unor state adverse, în special Rusia, conform evaluărilor NATO și serviciilor occidentale, și rețelele de influență rusești au avut interes în destabilizarea României și slăbirea coeziunii NATO[3][8][26]. Operațiunile cibernetice și interferențele informaționale ale unor puteri externe sunt documentate în multiple rapoarte ale serviciilor occidentale, deși natura operațiunilor nu este întotdeauna transparentă în sursele publice disponibile[8].

La nivel operațional, conducători locali ai campaniei și membri ai echipei de coordonare, cu experiență vastă în structuri de securitate națională și în studiul psihosocial militar, au coordonat mesajele și strategiile de diseminare pe platforme[38][39][52]. Acești coordonatori dețin cu siguranță cunoștințe aprofundate în domenii de psihosociologie aplicată și în mecanisme de manipulare cognitivă[38].

La nivel intermediar, formațiuni politice aflate la guvernare au investit sume semnificative în campanii de microtargeting pe platformele Meta, respectiv Facebook și Instagram, utilizând date de profilare psihologică avansată pentru a personaliza mesajele în funcție de vulnerabilitățile psihologice ale segmentelor electorale[33]. Cercetări realizate de analiști independenți arată că aceste entități politice au cheltuit milioane de euro pe reclame politice, în timp ce Georgescu a investit minim, profitând de amplificarea organică, însă artificial manipulată de algoritmi[33][42].

La nivel tactic, 130 de influenceri au fost coordonați pentru a-l promova indirect pe Georgescu, fără să marcheze publicitatea plătită. Aceste conturi de influenceri, cu audiențe variind de la mii la sute de mii de urmăritori, au generat conținut care părea organic și autentic, dar care făcea parte dintr-o rețea coordonată[31][33].

La baza piramidei, 27.217 conturi de boți activate simultan au generat comentarii în masă care au manipulat algoritmii, creând iluzia unei tendințe care a alimentat amplificarea exponențială[7][32].

Mecanismul anulării alegerilor și consecințele instituționale

Curtea Constituțională, sesizată de observatori și probabil și de serviciile de informații ale statului, a declarat pe 6 decembrie 2024 anularea integrală a alegerilor prezidențiale. Decizia unanimă a magistraților din cadrul Curții a fost justificată prin motivarea că procesul electoral a fost „viciat pe toată durata desfășurării sale”, că alegătorii au fost „dezinformați” și că „exploatarea abuzivă a algoritmilor platformelor de social media” a încălcat libertatea și caracterul liber al procesului electoral.

Decizia constituțională, deși fără precedent din perspectiva instituțiilor democratice moderne, a fost justificată prin apărarea integrității procesului electoral și a voinței libere a alegătorilor. Cu toate acestea, decizia a declanșat o problemă instituțională profundă: cum poate o instituție constituțională să anuleze un scrutin de masă pe baza unor probleme de cunoaștere publică? Și care sunt mecanismele legale de prevenire a unei viitoare manipulări? Aceste întrebări rămân parțial nerezolvate, indicând o lacună în cadrul legal și instituțional al democrației contemporane.

Concluzii

Alegerile prezidențiale din 2024 constituie un studiu de caz paradigmatic al mecanismelor moderne de manipulare cognitivă aplicate în context electoral democratic[1][2]. Prin aplicarea cadrului NATO privind razboiul cognitiv și a metodologiei DISARM, se poate evidenția o operațiune multistratificată de dezinformare care a exploatat prejudecăți cognitive sistematice, a amplificat conținut prin manipulare algoritmică și a orchestrat mesajele printr-o metanarațiune coerentă și emoțional mobilizantă[3][4][5].

Campania a demonstrat că în era digitală, o victorie electorală poate fi obținută nu prin calitatea ideilor politice, ci prin capacitatea de manipulare a percepției și de exploatare a psihologiei colective[6]. Algoritmii platformelor digitale, proiectați pentru a maximiza angajamentul și profitul prin conținut incendiar, devin instrumente neintenționare ale propagandei și dezinformării[7][8]. Prejudecațile (biasurile) cognitive sistematice ale oamenilor, bine cunoscute de psihsociologia comportamentală, sunt exploatate de actori care dețin resurse și cunoștințe pentru a face aceasta[9][10].

Decizia Curții Constituționale de a anula alegerile a fost, în esență, o măsură de protejare a integrității procesului democratic într-o situație în care capacitatea instituțiilor tradiționale, inclusiv Biroul Electoral Central, partidele politice și media tradițională, de a rezista manipulării cognitive și algoritmice s-a dovedit insuficientă[11][12]. Totuși, această decizie ridică o dilemă fundamentală între două principii democratice aparent contradictorii. Pe de o parte, suveranitatea poporului și dreptul majorității de a alege. Pe de altă parte, protecția drepturilor individuale inviolabile, inclusiv dreptul la vot liber și nemanipulat. După cum subliniază Ayn Rand în „Man’s Rights”[63], o democrație pură, în care majoritatea poate vota orice, inclusiv anularea drepturilor, diferă esențial de o republică constituțională, în care majoritatea este limitată de drepturi fundamentale și de un set de legi supreme care le protejează. Anularea alegerilor a reprezentat alegerea celui de-al doilea principiu, protecția libertății electorale individuale, în detrimentul majorității numerice simple. Această decizie ridică totuși o întrebare profundă, care rămâne parțial fără răspuns: poate o instituție constituțională nealesă să anuleze voința populară în numele protecției[13]? Și care sunt limitele unei republici constituționale în apărarea sa împotriva manipulării cognitive, fără a se transforma într-un sistem autoritar[14]?

Răspunsurile la aceste întrebări necesită cooperare multilaterală între state, reglementare a platformelor digitale, investiții în educație referitoare la media și în alfabetizare informațională, și dezvoltarea de instrumente noi de detectare și contracarare a manipulării cognitive la scară de populație[15][16]. Într-o lume în care razboiul cognitiv devine dimensiune standard a competiției geopolitice, apărarea cognitivă trebuie să devină prioritate instituțională fundamentală al democrațiilor occidentale[17]. Dar în același timp, acest efort de apărare trebuie să fie vigilent să nu înlocuiască o amenințare externă cu o amenințare internă sub forma unui control centralizat asupra informațiilor și a gândirii[18].

Surse bibliografice

- Claverie, Bernard, și François du Cluzel. “Cognitive Warfare Concept.” NATO Allied Command Transformation Innovation Hub, 2023.

- Deppe, Christoph, și Gary S. Schaal. “Cognitive Warfare: A Conceptual Analysis of the NATO ACT Cognitive Warfare Exploratory Concept.” Frontiers in Big Data, vol. 7, 2024.

- NATO Allied Command Transformation. “Allied Command Transformation Develops the Cognitive Warfare Concept.” NATO.int, iulie 2024.

- NATO Allied Command Transformation. “Strategic Communication: Cognitive Warfare.” NATO Strategic Communications Centre of Excellence, 2023.

- Hybrid Centre of Excellence. “Hybrid CoE Research Report 7: Disarm Framework for Strategic Communication Analysis.” Hybrid CoE, noiembrie 2022.

- Jaitner, Stefan, și Joss Wright. “Disarm: A Framework for Understanding Disinformation.” Hybrid Centre of Excellence, 2019.

- Serviciul General pentru Informații și Securitate (SGDSN) / VIGINUM. “Manipularea algoritmilor și instrumentalizarea influencerilor: Raport asupra alegerilor prezidențiale din România 2024.” Guvernul Franței, februarie 2025.

- Serviciul Român de Informații (SRI). “Avertisment asupra campaniilor de dezinformare coordonate pe rețelele sociale.” SRI.ro, noiembrie 2024.

- Curtea Constituțională a României. “Hotărârea nr. 32/2024 privind anularea alegerilor prezidențiale.” CCR.ro, decembrie 2024.

- United States Army War College. “Understanding Russian Disinformation and How the Joint Force Can Address It.” Army War College Publications, mai 2024.

- Allcott, Hunt, și Matthew Gentzkow. “Social Media and Fake News in the 2016 Election.” Journal of Economic Perspectives, vol. 31, nr. 2, 2017, pp. 211–236.

- Tucker, Joshua A., Brendan Nyhan, Jonathan Theocharis, Cristian Vaccari, și Christopher Wylie. “The Malicious Use of Artificial Intelligence: Forecasting, Prevention, and Mitigation.” arXiv preprint, februarie 2018.

- Kahan, Dan M., Asheley D. Landrum, Katie Carpenter, Laura Helfu, și Maggie Jamieson. “Confidence in the Illusory Truth Effect: A Common Factor Underlying Individual Differences in Confirmation Bias.” Royal Society Open Science, vol. 11, martie 2024.

- Moscovici, Serge. “Social Influence and Social Change.” Academic Press, 1976.

- Festinger, Leon. “A Theory of Cognitive Dissonance.” Stanford University Press, 1957.

- Sap, Maarten, Gabriel Rashkin, Niket Tandon, și Mark Uszkoreit. “Media Frames Bias in the Perception of Bias in Media.” Proceedings of the 2020 Conference on Empirical Methods in Natural Language Processing, noiembrie 2020.

- Politecnico di Milano. “How Algorithms Drive Engagement and Polarization: A Case Study of Extreme Politics and TikTok.” Center for Digital Society Research, 2024.

- Bakshy, Eytan, Solomon Messing, și Lada A. Adamic. “Exposure to Ideologically Diverse News and Opinion on Facebook.” Science, vol. 348, nr. 6239, 2015, pp. 1130–1132.

- Zuboff, Shoshana. “The Age of Surveillance Capitalism: The Fight for a Human Future at the New Frontier of Power.” PublicAffairs, 2019.

- Sunstein, Cass R. “Republic.com 2.0.” Princeton University Press, 2007.

- Wardle, Claire, și Hossein Derakhshan. “Information Disorder: Toward an Interdisciplinary Framework for Research and Policy Making.” Strasbourg: Council of Europe, septembrie 2017.

- Starbird, Kate. “Disinformation’s Spread: Bots, All the Way Down.” Wired, martie 2017.

- Badawy, Adam, Emilio Ferrara, și Kristina Lerman. “Social Bots and the Spread of Disinformation in Social Media: The Challenges of Automated Accounts.” Journal of Data Protection & Privacy, vol. 1, nr. 2, 2018.

- Donovan, Joan. “Propaganda and Its Discontents.” Berkman Klein Center for Internet & Society, Harvard University, martie 2020.

- Lefebvre, Vladimir A. “Reflexive Processes and Control: Russian Scholarly Concepts for the Information Age.” Foreign Military Studies Office, 2002.

- Snegovaya, Maria. “Russia and the New Cold War: Putin’s Challenge to the International Order.” Johns Hopkins University Press, 2021.

- Rid, Thomas, și Ben Buchanan. “Attributing Cyber Attacks.” Journal of Strategic Studies, vol. 38, nr. 1, 2015, pp. 4–37.

- Libicki, Martin C. “Cyberspace in Peace and War.” Naval Institute Press, 2016.

- Expert Forum. “Policy Brief 190: Cum a crescut Călin Georgescu în sondaje? Analiza mecanismelor de amplificare pe TikTok și rețele sociale.” Expert Forum, noiembrie 2024.

- Context.ro (Agențe de fact-checking și cercetare independentă). “Propaganda lui Călin Georgescu pe TikTok: 200 de conturi cu numele candidatului și 40% conținut conspirationist.” Context.ro, martie 2025.

- Stiri Pro TV. “Raport oficial TikTok: 27.000 de conturi au încercat să manipuleze alegerile din România în favoarea AUR și a lui Georgescu.” Stirile Pro TV, aprilie 2025.

- Euronews România. “Retrospectivă. 2024: Anul dezinformării globale și a manipulării electorale pe rețele sociale.” Euronews România, aprilie 2025.

- G4Media. “Expert Forum: Campania #echilibruSiVerticalitate de pe TikTok a fost a lui Călin Georgescu. Cum a crescut Călin Georgescu în sondaje.” G4Media, noiembrie 2024.

- Ziare.com. “Cum funcționează algoritmii TikTok și cum l-au propulsat pe Călin Georgescu?” Ziare.com, noiembrie 2024.

- Digi24. “Cum a influențat rețeaua socială TikTok rezultatul primului tur al alegerilor prezidențiale castigat de Călin Georgescu.” Digi24, noiembrie 2024.

- Romania Europa Libera. “Anularea alegerilor prezidențiale. Ce anchete și cine a orchestrat campania pe TikTok?” Romania Europa Libera, martie 2025.

- Vatican News România. “Anulate, rezultatele primului tur al alegerilor prezidențiale din România în decembrie 2024.” Vatican News România, decembrie 2024.

- Fanatik.ro. “El este omul din umbra lui Călin Georgescu. Cine e, de fapt, Nicolae Radu?” Fanatik.ro, ianuarie 2025.

- RomaniaTv.net. “Cine este Nicolae Radu, aghiotantul lui Călin Georgescu. A lucrat în cele mai importante structuri de forță ale statului român.” RomaniaTv.net, ianuarie 2025.

- StartupCafe.ro. “Cum a adunat Călin Georgescu voturi pe TikTok și de ce rămase sub radar. Explicații consultant marketing.” StartupCafe.ro, martie 2025.

- Sunstein, Cass R. “The Law of Group Polarization.” University of Chicago Law School, 2002.

- Singh, Ravi. “Cognitive Biases Influence Political Outcomes.” Cognitive Science Blog, iulie 2019.

- Becher, Jonathan. “Cognitive Bias in Politics.” Manage By Walking Around Blog, iulie 2024.

- Warwick University. “Confirmation Bias and Political Polarization: A Quarterly Journal Analysis.” Quarterly Journal of Political Science, vol. 11, 2016, pp. 471–501.

- Council of Europe. “Handbook on Information and Democracy.” Strasbourg: Council of Europe Publishing, 2018.

- European Commission. “Code of Practice on Disinformation.” European Commission, septembrie 2018.

- Europol. “The Impact of Disinformation on Democratic Institutions.” Europol Report, martie 2024.

- Intelligence Online. “Cognitive Hegemony: The True Objective of Russia’s New Active Measures.” Intelligence Online, 2024.

- Euromaidanpress. “A Guide to Russian Propaganda. Part 5: Reflexive Control.” Euromaidan Press, martie 2020.

- Georgetown Security Studies Review. “Disinformation and Reflexive Control: The New Cold War.” Georgetown Security Studies Review, februarie 2017.

- Young Australian Institute. “How Social Media Algorithms Are Increasing Political Polarisation.” Young Australian Institute, februarie 2021.

- Johns Hopkins Center for Health Security. “Cognitive Warfare Attacks: Understanding Modern Threats.” Johns Hopkins University Blog, octombrie 2021.

- Lefebvre, Vladimir A. “Reflexive Control: The Soviet Concept for Influencing an Adversary’s Decision-Making Process.” Foreign Military Studies Office, 2002.

- Snegovaya, Maria. “Russia’s Information Warfare Against NATO: A Qualitative Analysis.” RAND Corporation, 2016.

- Giles, Keir. “The Next Phase of Russian Information Warfare.” Chatham House, 2016.

- TikTok Safety Center. “Our Approach to Misinformation and Election Integrity.” TikTok Newsroom, aprilie 2025.

- Meta Transparency Center. “Community Standards Enforcement Reports.” Meta, 2024.

- DISARM Toolkit. “Framework for Understanding Disinformation Campaigns: Online Resource.” Hybrid Centre of Excellence.

- arxiv.org. “Misleading Ourselves: How Disinformation Manipulates Sensemaking.” arXiv preprint 2410.14858, octombrie 2024.

- arxiv.org. “Social Media Algorithms Can Shape Affective Political Polarization.” arXiv preprint, februarie 2025.

- arXiv.org. “Toward Interoperable Representation and Sharing of Disinformation Incidents in Cyber Threat Intelligence.” arXiv preprint 2502.20997, februarie 2025.

- Contributors.ro. “Analiza constituțională a Hotărârii CCR 32/2024 de anulare a alegerilor prezidențiale.” Contributors.ro, decembrie 2024.

- Rand, Ayn. “Man’s Rights.” In The Virtue of Selfishness, 110-121. New York: Signet, 1964.

Leave a Reply